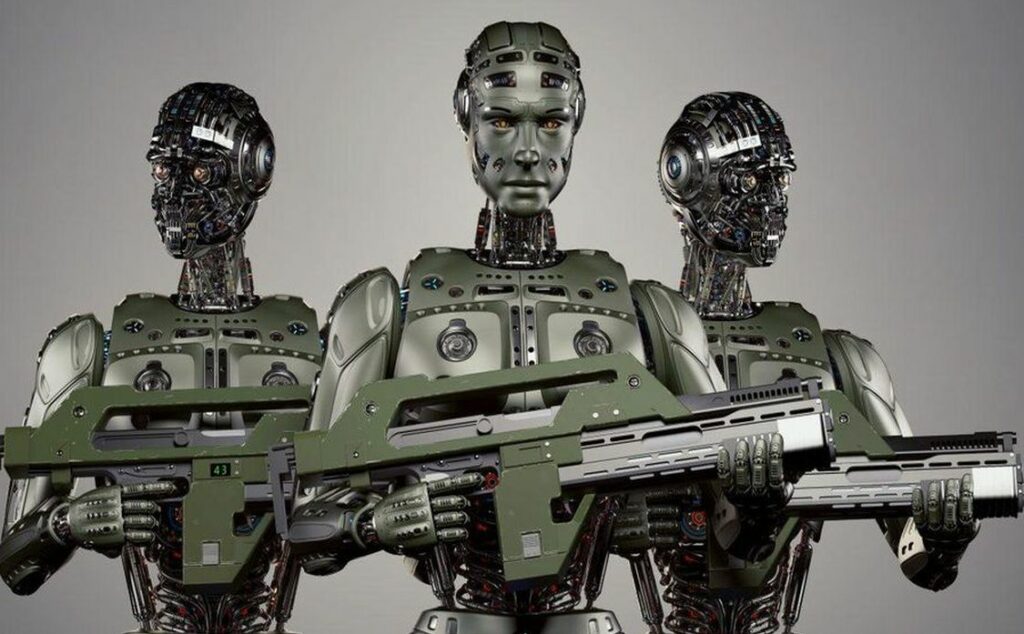

Buenos Aires (AT) – Austria llamó regular el empleo de la inteligencia artificial en sistemas de armas que podrían dar origen a los conocidos como “robots asesinos”.

Con el avance vertiginoso de la tecnología de IA, los sistemas de armamento capaces de causar daño sin intervención humana están cada vez más próximos. Esto genera dilemas éticos y legales que la mayoría de los países consideran imperativo abordar con urgencia.

“No podemos dejar pasar este momento sin tomar medidas”, afirmó el Ministro de Relaciones Exteriores de Austria, Alexander Schallenberg, durante una reunión que congregó a organizaciones no gubernamentales e internacionales, así como a representantes de 143 naciones.

“Es hora de convenir reglas y normativas internacionales que garanticen el control humano. Al menos, aseguremos que la decisión más trascendental y profunda, quién vive y quién muere, permanezca en manos de seres humanos y no de máquinas”, expuso en su discurso inaugural en la conferencia titulada “Humanidad en la encrucijada: Sistemas de Armas Autónomas y el Desafío de la Regulación”.

A pesar de años de deliberaciones en las Naciones Unidas, se tuvieron escasos resultados tangibles, y muchos participantes en la conferencia de dos días en Viena coincidieron en que la ventana de oportunidad se está cerrando rápidamente.

“Es sumamente importante actuar y hacerlo con celeridad”, subrayó la presidenta del Comité Internacional de la Cruz Roja, Mirjana Spoljaric, durante un panel de debate.

“Lo que estamos presenciando en distintos contextos de violencia son fallos morales ante la comunidad internacional. Y no deseamos ver que tales fallos se aceleren al confiar la responsabilidad de la violencia, el control sobre la violencia, a máquinas y algoritmos”.

Guerra de robots

La inteligencia artificial ya está siendo empleada en el campo de batalla. Según diplomáticos, los drones en Ucrania están programados para hallar su propio rumbo hacia el objetivo cuando la tecnología de interferencia de señales los desconecta de su operador.

Este mes, Estados Unidos anunció que estaba investigando un informe mediático que sugería que el ejército israelí había recurrido a la IA para asistir en la identificación de objetivos de bombardeo en Gaza.

“Ya hemos observado errores de selección de IA de variadas magnitudes, desde el reconocimiento equivocado de la cabeza calva de un árbitro como un balón de fútbol, hasta víctimas mortales entre los peatones provocadas por vehículos autónomos incapaces de identificar el cruce peatonal”, manifestó Jaan Tallinn, un programador de software e inversor tecnológico, en su discurso durante la conferencia.

“Debemos ser sumamente cautos en cuanto a la fiabilidad de estos sistemas, ya sea en el ámbito militar o civil”.

Los peligros de la IA en la guerra

Las potencias mundiales compiten por el desarrollo y la implementación de sistemas de IA en sus fuerzas armadas. Desde drones autónomos hasta sistemas de defensa cibernética avanzada, la IA se convirtió en un componente central de la moderna estrategia militar. Sin embargo, esta carrera armamentística plantea serias interrogantes sobre la estabilidad y la seguridad internacional.

Uno de los mayores temores es el desarrollo de armas completamente autónomas, capaces de tomar decisiones cruciales sin intervención humana. Estos sistemas, aunque teóricamente más eficientes, plantean serias preocupaciones éticas y legales.

La falta de control humano podría resultar en errores catastróficos y violaciones de los derechos humanos, socavando los principios fundamentales del derecho internacional humanitario.

Otro aspecto preocupante es la creciente dependencia de la IA en la defensa cibernética. Si bien estos sistemas pueden mejorar la detección y respuesta a ataques informáticos, también introducen nuevas vulnerabilidades. Los ciberataques respaldados por IA podrían ser más sofisticados y difíciles de detectar, lo que aumenta el riesgo de escalada y conflicto.

Además, el uso de la IA en la guerra plantea cuestiones éticas profundas que deben abordarse con urgencia. ¿Es moralmente aceptable delegar decisiones de vida o muerte a máquinas? ¿Quién es responsable en caso de errores o violaciones de derechos humanos? Estas preguntas exigen un debate global sobre los límites éticos de la guerra en la era digital.

Hacé tu comentario