Una serie de videos generados con inteligencia artificial que muestran mujeres exhibidas dentro de vitrinas como si fueran objetos acumularon más de nueve millones de reproducciones y fueron atribuidos falsamente a distintas ciudades del mundo. Las piezas, que circularon en TikTok, X, Instagram y otras plataformas, forman parte de una estrategia comercial diseñada para producir y viralizar contenido sintético con fuerte carga sexual y estereotipos degradantes. La investigación que rastreó su origen expuso un modelo industrial de desinformación y cosificación.

El material presenta avatares femeninos sentados en cubículos de vidrio iluminados, con el nombre de una ciudad y la bandera del país correspondiente sobreimpresos. La escena sugiere un mercado de mujeres disponibles para consumo.

El impacto fue inmediato. En pocas horas, el video alcanzó picos de 9,5 millones de visualizaciones en cuentas replicadoras. La circulación masiva instaló una narrativa que afecta la imagen de una ciudad que intenta dejar atrás décadas de asociación con narcotráfico y explotación sexual.

Un engranaje industrial de contenido sintético

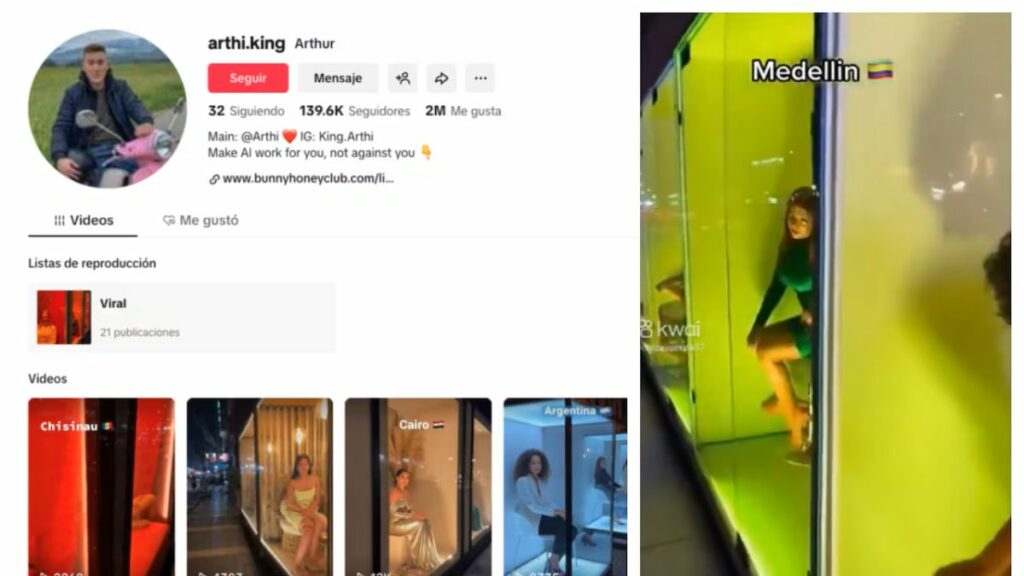

El rastreo digital identificó que los videos forman parte de una serie producida por una agencia con sede en Frankfurt, Alemania, que utiliza herramientas generativas para fabricar clips similares para distintas ciudades del mundo. Por ejemplo, un contenido atribuido a Medellín es una adaptación de una plantilla replicada en al menos 30 versiones hasta febrero de 2026.

Entre esas versiones también se identificó una adaptación rotulada como “Argentina”, que mantiene el mismo formato visual: mujeres generadas por inteligencia artificial exhibidas en vitrinas con iluminación artificial y referencias nacionales superpuestas.

El formato es idéntico. Cambian el nombre de la ciudad, la bandera y el audio con acentos locales. La estructura se mantiene. Mujeres generadas por IA. Vitrinas. Iluminación artificial. Mensajes insinuantes. El producto no es un error tecnológico: es una estrategia comercial planificada.

Las versiones atribuidas a Medellín, Argentina y otras ciudades responden a la misma plantilla automatizada. No son producciones independientes. Son variaciones de un mismo esquema diseñado para maximizar polémica y viralidad.

El contenido original se publicó en TikTok bajo el perfil @arthi.king, vinculado a la agencia. Desde allí, el material migró a cuentas conocidas por amplificar piezas polémicas para monetizar su alcance. Influencers y perfiles anónimos tomaron el video, añadieron marcas de agua o comentarios propios y lo redistribuyeron en X, Instagram, Kwai y YouTube.

El modelo funciona con automatización y escala. Una vez creada la plantilla, el sistema permite producir decenas de versiones localizadas en cuestión de horas. Cada ciudad se convierte en un nuevo disparador de polémica y tráfico digital. La viralización no depende de la veracidad. Depende del impacto.

En su sitio web, la firma alemana se presenta como un estudio de automatización con inteligencia artificial orientado al contenido para adultos y a la optimización de flujos de trabajo digitales. Exhibe cifras de alcance y testimonios de clientes. Promueve oportunidades para “modelos” en ciudades turísticas. La narrativa empresarial se apoya en resultados medidos en miles de millones de visualizaciones.

La ruta de la viralidad y el negocio detrás

El recorrido del video revela una lógica de difusión organizada. Primero se publica en la cuenta matriz. Luego lo capturan perfiles especializados en viralidad. Estos perfiles lo redistribuyen con comentarios alarmistas o insinuantes. Cada réplica suma interacciones. El algoritmo amplifica. La monetización llega por publicidad, donaciones o suscripciones.

Quienes replican el contenido no siempre tienen vínculo formal con la agencia original, pero obtienen beneficios económicos y notoriedad. El ecosistema se retroalimenta. La polémica es combustible.

El video sobre Medellín superó nueve millones de reproducciones en una sola plataforma en menos de 24 horas. Ese volumen sugiere promoción coordinada o utilización de redes automatizadas para potenciar el alcance inicial. La expansión fue rápida y transversal.

Las señales de síntesis digital son evidentes para un ojo entrenado. Avatares sin piernas definidas. Proporciones corporales que cambian entre fotogramas. Reflejos inconsistentes en el vidrio. Texturas repetitivas en la ropa. Son marcas típicas de modelos generativos. Sin embargo, la mayoría de los usuarios no analiza esos detalles. Consume y comparte.

Ninguna de las plataformas implicadas colocó advertencias visibles sobre la naturaleza artificial del contenido. Tampoco limitaron su difusión inicial. El material se integró al flujo habitual de publicaciones virales sin contexto ni aclaración.

Impacto reputacional y debate ético

La circulación del video coincidió con un momento sensible para Medellín. La administración local impulsa campañas para desalentar el turismo sexual y combatir redes de explotación. Migración Colombia informó que hasta fines del año pasado se inadmitieron 105 ciudadanos extranjeros por posibles vínculos con explotación sexual. En ese contexto, el clip alimenta prejuicios y refuerza estigmas.

El fenómeno también reaviva la discusión sobre el uso de inteligencia artificial sin regulación clara. Especialistas advierten que la tecnología permite fabricar narrativas verosímiles a gran escala. Cuando el incentivo económico se combina con la ausencia de controles éticos, el resultado puede ser dañino.

En el caso argentino, la inclusión del nombre del país dentro del mismo formato expone también a Buenos Aires y a la marca país a una narrativa de cosificación que no surge de hechos reales sino de una construcción artificial diseñada con fines comerciales.

El historiador Yuval Noah Harari planteó en su libro Nexus que en los próximos años las redes de información incorporarán millones de agentes de IA capaces de procesar datos y tomar decisiones sin intervención humana directa. Sostiene que esas decisiones pueden resultar extrañas o imprevisibles. En el caso de los videos virales, la extrañeza se traduce en desinformación y cosificación.

El perfil que publicó inicialmente los videos desapareció de algunas plataformas tras la exposición pública. Sin embargo, las copias continúan circulando. En el entorno digital, borrar el origen no elimina el rastro.

Hacé tu comentario