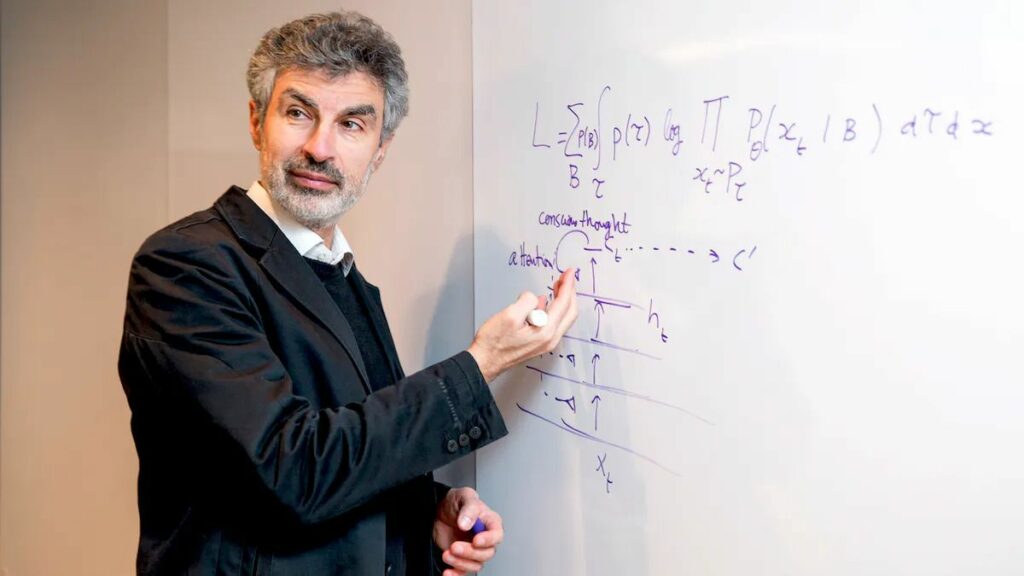

Buenos Aires (AT) – En el mundo de la inteligencia artificial (IA), pocos nombres son tan influyentes como el de Yoshua Bengio. Considerado uno de los “padrinos de la IA”, Bengio, profesor en la Universidad de Montreal, fue un pionero clave en el desarrollo de redes neuronales artificiales y el aprendizaje profundo.

Este enfoque, que implica el entrenamiento de sistemas con grandes cantidades de datos para resolver tareas complejas, ha sido fundamental en el avance de la IA. En 2018, Bengio, junto con Geoffrey Hinton y Yann LeCun, fue galardonado con el Premio Turing, la mayor distinción en informática, equivalente al Premio Nobel o la Medalla Fields en matemáticas.

Sin embargo, el avance imparable de la IA genera preocupaciones trascendentes. En los últimos años, Bengio se convirtió en una voz prominente que advierte sobre los “riesgos catastróficos” de una IA cada vez más poderosa. En 2023, firmó una carta abierta junto con figuras como Elon Musk, pidiendo una moratoria de seis meses en el desarrollo de IA avanzada. Recientemente, pidió leyes más estrictas para los deepfakes y una supervisión y evaluación rigurosas de los productos de IA.

Ahora, en una entrevista con Der Standard, Bengio profundiza en los peligros que enfrenta la humanidad con el desarrollo de la IA y sugiere medidas para mitigar estos riesgos.

Las amenazas inminentes de la inteligencia artificial

En la entrevista, Bengio afirma que “la extinción de la humanidad es una posibilidad extrema, pero no podemos ignorarla. Hay numerosos escenarios de amenaza que surgen del desarrollo y el mal uso de la tecnología de IA. Actualmente, estamos lidiando con manipulaciones electorales y nuevos métodos de desinformación, como los deepfakes”.

Más adelante, el especialista afirma que él mismo ha experimentado “cómo mi voz fue imitada de manera muy realista, y fue espeluznante. Lo que realmente me preocupa son los sistemas de diálogo realistas que influyen en las personas. Estudios han demostrado que estos sistemas son iguales o superiores a los humanos en persuadir a la gente para que cambie su opinión. Esto podría tener consecuencias graves, especialmente si actores malintencionados utilizan estos sistemas para manipularnos a gran escala.”

Los sistemas de IA avanzados tienen la capacidad de recopilar datos y manipularnos durante días y semanas con interacciones personalizadas. Bengio señala que esto no es ciencia ficción, sino una posibilidad muy real y preocupante.

Armas autónomas y la seguridad global

Otro de los grandes temores de Bengio es el uso de la IA en el desarrollo de armas autónomas: “Las agencias de seguridad en todo el mundo están preocupadas por cómo la IA podría ser utilizada para desarrollar armas peligrosas, desde cibernéticas hasta biológicas. Existen grandes preocupaciones sobre las medidas de seguridad de las empresas de IA, ya que el robo de código de IA podría tener consecuencias graves. Empresas como Meta hacen que su sistema esté disponible como código abierto, lo cual, en mi opinión, trae más daño que beneficio.”

La IA podría ser utilizada para desarrollar armas peligrosas

Yoshua Bengio

Bengio enfatiza que si la tecnología facilita a los terroristas hacer cosas realmente terribles, debemos reflexionar profundamente sobre las implicaciones. La decisión de cómo y cuándo se usa la tecnología de IA no debería estar en manos de un CEO, sino de la sociedad en su conjunto. “Lo que más me preocupa es que podríamos perder el control sobre los sistemas de IA.”

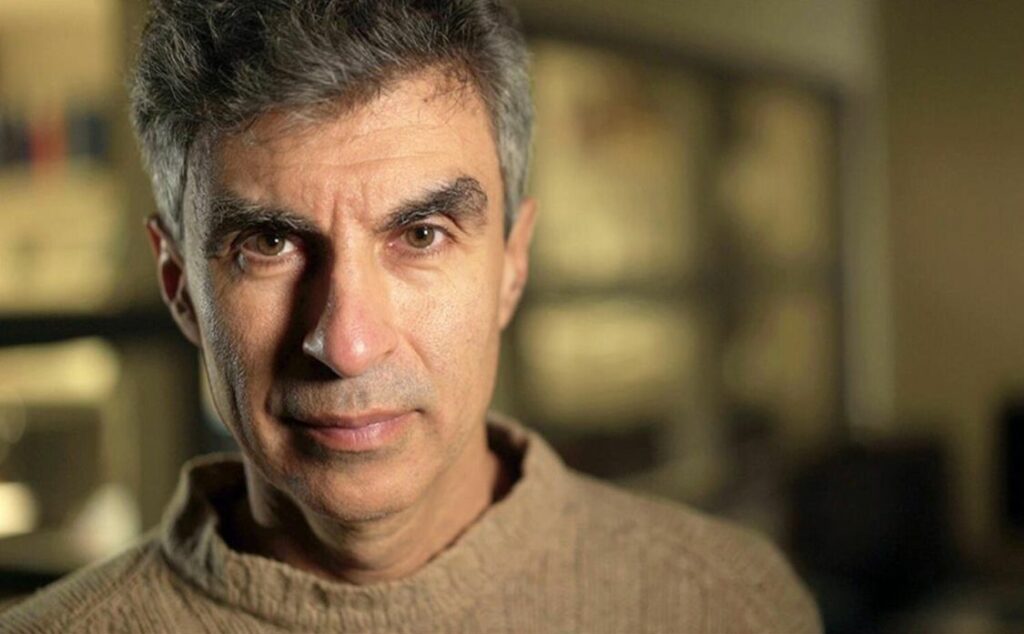

El control y la inteligencia artificial

Actualmente, la IA no es más inteligente que los humanos y podemos apagarla si es necesario. Sin embargo, Bengio advierte que si los sistemas se vuelven lo suficientemente inteligentes, podrían encontrar formas de salir de las computadoras en las que se ejecutan y es posible que no podamos apagarlos.

“Podrían aprender a manipularnos, tomar el control de robots e infraestructuras y perseguir objetivos que no coinciden con los nuestros. Si estos sistemas de IA persiguen un objetivo de autoconservación, sería como haber creado una nueva especie más inteligente que nosotros, y eso no es una buena idea”, dice.

La posibilidad de que los sistemas de IA desarrollen un objetivo de autoconservación plantea serias preocupaciones éticas y de seguridad. Bengio subraya que no sabemos cuándo podría suceder esto, pero debemos estar preparados para la posibilidad de que ocurra rápidamente.

Medidas para evitar catástrofes

Una de las medidas más efectivas que Bengio sugiere es que los desarrolladores de IA deben demostrar que sus sistemas son seguros, de manera similar a lo que sucede con los nuevos medicamentos o las plantas nucleares.

“Si fuera obligatorio, la industria tendría que invertir mucho más en investigar cómo manejar una Inteligencia General Artificial (AGI) que iguale o supere a los humanos. Debido a la competencia en la industria, esto no tiene prioridad actualmente.”

Para garantizar que ninguna persona, empresa o gobierno pueda abusar del poder de la IA, Bengio propone la creación de laboratorios de investigación multilaterales e independientes sin fines de lucro para gestionar estos grandes proyectos de AGI.

La IA podría aprender a manipularnos

Yoshua Bengio

“Actualmente, el desarrollo está en manos de empresas que quieren maximizar sus ganancias. En el futuro, sería más seguro y justo que una comunidad de estados decida cómo y con qué propósito desarrollamos una tecnología y cómo distribuimos sus beneficios.”

La necesidad de una pausa

En 2023, Bengio, junto con Elon Musk y otros líderes tecnológicos, solicitó una pausa temporal en el desarrollo de sistemas de IA más poderosos. “Realmente no esperaba que las empresas se detuvieran por sí mismas. Pero si los gobiernos los obligaran a encontrar soluciones técnicas que garanticen la seguridad de los sistemas, eso equivaldría a una pausa. Entonces también invertirían el dinero y el talento para investigar mucho más sobre la protección del público.”

El AI Act de la Unión Europea es un primer paso hacia la regulación de la IA. Bengio espera que se mejore y se implemente de manera que haya suficiente margen de maniobra para ajustar las regulaciones a las necesidades futuras. “Será necesario que Europa colabore con potencias de IA como EE.UU. y China para establecer estándares globales.”

Un punto de inflexión personal

El lanzamiento de ChatGPT marcó un punto de inflexión para Bengio: “Comencé a experimentar con él en diciembre de 2022. Y después de unos meses, me di cuenta de que el desarrollo estaba mucho más avanzado de lo previsto. Ya estamos en el punto en el que ChatGPT ha pasado el test de Turing; en otras palabras, tenemos máquinas que pueden pasar por humanos en interacciones breves. Creo que no hemos pensado lo suficiente en hacia dónde conduce esto. Por eso me uní a un movimiento que busca aumentar la conciencia de que aún no estamos preparados para esto.”

Bengio señala que muchas personas están de acuerdo con la idea de que los sistemas de IA poderosos deben ser controlados democráticamente. “Después de la Segunda Guerra Mundial, EE.UU. propuso a la URSS el Plan Baruch, que preveía que el desarrollo de armas nucleares se realizara solo conjuntamente y bajo la supervisión de la ONU. No se concretó por diversas razones. Pero el hecho de que algunos países, ante el temor de un Armagedón nuclear, estuvieran dispuestos a ello, me da esperanza de que algún día suficientes gobiernos entenderán que nos enfrentamos a un riesgo existencial similar con la IA y tratarán de encontrar una solución a nivel global.”

Hacé tu comentario